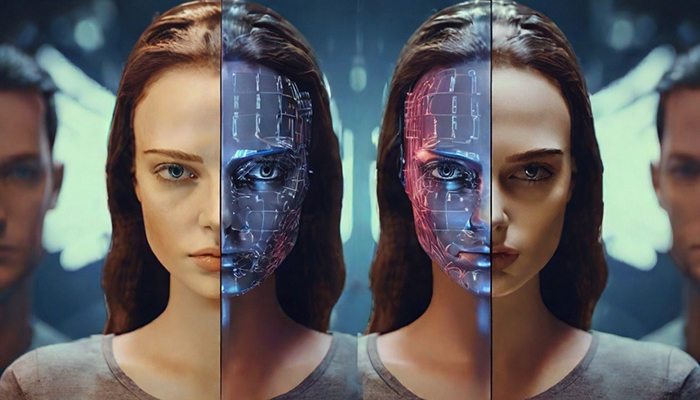

دنیای دیجیتال با سرعتی باورنکردنی در حال دگرگونی است و هوش مصنوعی مولد (Generative AI)، در خط مقدم این تحولات قرار دارد. یکی از قدرتمندترین و در عین حال نگرانکنندهترین محصولات این فناوری، “دیپ فیک” یا “جعل عمیق” (Deepfake) است؛ تکنیکی که با استفاده از الگوریتمهای پیچیده یادگیری عمیق، امکان ساخت ویدیوها، تصاویر و صداهای جعلی اما بسیار واقعگرایانه را فراهم میکند.

دیپ فیکها دیگر یک پدیده نادر و محدود به آزمایشگاههای تحقیقاتی نیستند؛ آنها به ابزاری در دسترس تبدیل شدهاند که میتوانند برای اهداف مختلفی، از سرگرمی و هنر گرفته تا پروپاگاندای سیاسی، کلاهبرداریهای مالی و انتشار اطلاعات نادرست و مخرب، به کار گرفته شوند.

در چنین فضایی، توانایی تشخیص دیپ فیک دیگر یک مهارت تخصصی برای کارشناسان سایبری نیست، بلکه یک بخش ضروری از سواد رسانهای برای هر فردی است که در شبکههای اجتماعی فعالیت دارد و اخبار و اطلاعات خود را از این بسترها دریافت میکند. این مقاله با هدف توانمندسازی شما در برابر این چالش نوین، به بررسی دقیق و گام به گام روشها و نشانههایی میپردازد که به شما در شناسایی این محتواهای جعلی کمک میکنند.

دیپ فیک (جعل عمیق) چیست و چگونه به این شکل واقعگرایانه ساخته میشود؟ (نگاهی کوتاه و ساده)

برای اینکه بتوانیم به تشخیص دیپ فیک بپردازیم، ابتدا باید درک کنیم که این فناوری چیست و چگونه کار میکند.

تعریف دیپ فیک: دیپ فیک، ترکیبی از دو واژه “یادگیری عمیق” (Deep Learning) و “جعل” (Fake) است. این فناوری از الگوریتمهای هوش مصنوعی برای تحلیل حجم عظیمی از دادههای صوتی و تصویری یک فرد (مثلاً هزاران عکس و ساعتها فیلم از یک شخصیت سیاسی) و سپس ترکیب یا جایگزین کردن چهره یا صدای آن فرد بر روی یک ویدیوی منبع دیگر استفاده میکند. نتیجه، ویدیویی است که در آن، به نظر میرسد آن شخص حرفهایی را میزند یا کارهایی را انجام میدهد که در واقعیت هرگز انجام نداده است.

فناوری پشت پرده (به زبان ساده): اکثر دیپ فیکها با استفاده از مدلی به نام “شبکههای مولد تخاصمی” (Generative Adversarial Networks – GANs) ساخته میشوند.

در این مدل، دو شبکه عصبی با یکدیگر رقابت میکنند: یک شبکه “سازنده” (Generator) که تلاش میکند تصاویر یا ویدیوهای جعلی هرچه واقعیتری بسازد، و یک شبکه “تشخیصدهنده” (Discriminator) که تلاش میکند جعلی بودن آنها را تشخیص دهد. این رقابت مداوم، باعث میشود که شبکه سازنده به مرور زمان در ساخت جعلهای بینقصتر، ماهرتر شود.

بخش اول: نشانههای فنی و بصری برای تشخیص دیپ فیک (سرنخهایی در پیکسلها)

اگرچه فناوری ساخت دیپ فیک به سرعت در حال پیشرفت است، اما هنوز هم اغلب بینقص نیست و سرنخهای بصری و شنیداری ظریفی را از خود به جای میگذارد. البته باید به یاد داشت که با پیشرفت تکنولوژی، این نشانهها ممکن است کمتر و کمتر شوند.

۱. ناهماهنگیها و موارد غیرطبیعی در چهره، چشمها و حرکات

پلک زدن غیرطبیعی یا عدم پلک زدن: الگوریتمهای اولیه در شبیهسازی الگوی طبیعی پلک زدن انسان با مشکل مواجه بودند. ویدیوهایی که در آن فرد برای مدتی طولانی پلک نمیزند یا الگوی پلک زدن او بسیار نامنظم است، میتواند مشکوک باشد.

حرکات لب ناهماهنگ با صدا (Lip Sync ضعیف): یکی از دشوارترین بخشها برای هوش مصنوعی، ایجاد هماهنگی کامل بین حرکات لب و کلمات ادا شده است. به دنبال هرگونه ناهماهنگی جزئی، تأخیر یا حرکت غیرطبیعی در لبها باشید.

پوست بیش از حد صاف، مومیشکل یا عجیب: گاهی اوقات، پوست چهره در ویدیوهای دیپ فیک به طور غیرطبیعی صاف و بدون جزئیات به نظر میرسد. همچنین، ممکن است چین و چروکها یا خطوط چهره با سن یا حالت چهره فرد همخوانی نداشته باشند.

اندازه یا شکل غیرطبیعی دندانها و داخل دهان.

۲. ناهنجاریهای بصری و فیزیکی در تصویر و محیط ویدیو

نورپردازی، سایهها و انعکاسهای ناهماهنگ: به دقت بررسی کنید که آیا نورپردازی روی چهره فرد با نورپردازی محیط اطراف او همخوانی دارد یا خیر. سایههایی که در جهت اشتباهی افتادهاند یا انعکاسهای غیرطبیعی در چشمها یا عینک فرد، میتوانند نشانههای مهمی برای تشخیص دیپ فیک باشند.

لبههای عجیب، تار و محو در اطراف چهره، موها یا گردن: فرآیند ترکیب چهره جعلی با بدن فرد در ویدیوی منبع، گاهی اوقات منجر به ایجاد لبههای تار، لرزان یا غیرطبیعی در محل اتصال این دو میشود. این ناهنجاری به خصوص در اطراف موها که جزئیات زیادی دارند، بیشتر قابل مشاهده است.

رنگ پوست ناهماهنگ بین چهره و سایر اعضای بدن (مانند گردن یا دستها).

حرکات سر یا بدن که با یکدیگر هماهنگ نیستند.

۳. کیفیت پایین ویدیو و ناهماهنگیهای صوتی و شنیداری

کیفیت پایین یا فشردهسازی بیش از حد: سازندگان دیپ فیک گاهی اوقات به طور عمدی کیفیت ویدیو را کاهش میدهند تا نقصها و ناهنجاریهای بصری آن را پنهان کنند. بنابراین، به ویدیوهای بسیار مهم و جنجالی که با کیفیت پایین منتشر میشوند، با دیده تردید نگاه کنید.

صدای رباتیک، نویزهای عجیب یا تغییرات ناگهانی در لحن: اگرچه فناوری شبیهسازی صدا نیز پیشرفت زیادی کرده، اما گاهی اوقات صدای تولید شده ممکن است فاقد احساسات طبیعی، دارای لحنی رباتیک، یا همراه با نویزهای پسزمینه غیرعادی باشد. این نیز یکی از راههای تشخیص دیپ فیک است.

بخش دوم: سرنخهای محتوایی و منطقی (مهمترین ابزار شما: تفکر انتقادی)

با پیشرفت فناوری، نشانههای فنی به تدریج کمتر میشوند. در اینجاست که مهمترین ابزار شما، یعنی تفکر انتقادی و تحلیل محتوا، وارد میدان میشود.

۱. بررسی دقیق منبع و اعتبار شخص یا رسانه منتشرکننده

پیش از باور کردن یا به اشتراک گذاشتن هر ویدیوی جنجالی، از خود بپرسید: این ویدیو اولین بار توسط چه کسی یا چه رسانهای منتشر شده است؟ آیا منبع آن یک خبرگزاری معتبر و شناختهشده است یا یک حساب کاربری ناشناس در شبکههای اجتماعی؟ ویدیوهای دیپ فیک اغلب از طریق کانالهای غیررسمی و نامعتبر منتشر میشوند.

۲. جستجوی وارونه تصویر یا ویدیو برای یافتن منبع اصلی

میتوانید از بخشهای کلیدی ویدیو اسکرینشات گرفته و از ابزارهایی مانند “جستجوی تصویری گوگل” (Google Image Search) برای انجام جستجوی وارونه استفاده کنید. این کار ممکن است به شما کمک کند تا تصویر یا ویدیوی اصلی را که برای ساخت دیپ فیک از آن استفاده شده، پیدا کنید.

۳. تحلیل منطقی محتوای پیام: آیا این حرف یا رفتار، منطقی و باورپذیر است؟

این یکی از قدرتمندترین روشهای تشخیص دیپ فیک است. از خودتان بپرسید:

آیا شخصیت مورد نظر در ویدیو، واقعاً و در دنیای واقعی چنین حرفی را میزند یا چنین رفتاری را انجام میدهد؟ آیا این محتوا با شخصیت، باورها و سوابق قبلی او همخوانی دارد؟

آیا محتوای ویدیو برای برانگیختن احساسات شدید و آنی (مانند خشم، ترس، نفرت یا هیجان شدید) در شما طراحی شده است؟ هدف اصلی بسیاری از دیپ فیکهای مخرب، ایجاد واکنشهای احساسی سریع و جلوگیری از تفکر منطقی است.

۴. جستجو برای پوشش خبری آن رویداد در سایر رسانههای معتبر و مستقل

اگر یک شخصیت سیاسی مهم، یک بیانیه جنجالی و تکاندهنده را در یک ویدیو اعلام کند، این یک خبر بسیار بزرگ خواهد بود و به سرعت توسط تمامی خبرگزاریهای معتبر و بزرگ در سراسر جهان پوشش داده خواهد شد. اگر ویدیویی را مشاهده کردید که ادعای بزرگی را مطرح میکند اما هیچ رسانه معتبر دیگری به آن نپرداخته است، به احتمال بسیار زیاد آن ویدیو جعلی است.

آینده تشخیص دیپ فیک: یک مسابقه تسلیحاتی بیپایان بین جعل و شناسایی

متاسفانه، با پیشرفت فناوری، تشخیص دیپ فیک روز به روز دشوارتر خواهد شد. این فرآیند به یک مسابقه تسلیحاتی بیپایان بین الگوریتمهای سازنده دیپ فیک و الگوریتمهای تشخیصدهنده آن تبدیل شده است. در آینده، احتمالاً دیگر نمیتوان تنها با چشم غیرمسلح به طور قطعی یک ویدیوی جعلی را تشخیص داد. به همین دلیل، متخصصان در حال کار بر روی راهکارهای جدیدی مانند “واترمارکینگ دیجیتال” (Digital Watermarking) و استانداردهای احراز اصالت محتوا (مانند استاندارد C2PA) هستند که به دوربینها و نرمافزارها اجازه میدهد تا از همان لحظه تولید، یک امضای دیجیتال غیرقابل تغییر را به محتوای ویدیویی اضافه کنند تا اصالت آن قابل تأیید باشد.

سوالات متداول (FAQ) در مورد تشخیص دیپ فیک

۱. آیا دیپ فیک فقط برای ساخت ویدیوهای جعلی از افراد مشهور و چهرههای سیاسی استفاده میشود؟

خیر. اگرچه دیپ فیکهای مربوط به افراد مشهور بیشترین توجه رسانهای را به خود جلب میکنند، اما این فناوری میتواند علیه افراد عادی نیز به کار گرفته شود. از جمله خطرات جدی آن میتوان به ساخت محتوای غیراخلاقی و انتقامجویانه، کلاهبرداریهای مالی (با شبیهسازی صدای یک فرد برای درخواست پول از خانوادهاش)، و قلدری سایبری اشاره کرد. بنابراین، خطر دیپ فیک متوجه همه افراد جامعه است.

۲. تفاوت اصلی و کلیدی بین یک ویدیوی “دیپ فیک” و یک ویدیوی “ویرایش شده” یا “مونتاژ شده” معمولی چیست؟

تفاوت اصلی در فناوری و سطح واقعگرایی است. در یک ویدیوی مونتاژ شده معمولی، ممکن است بخشهای مختلفی از چند ویدیو به هم چسبانده شوند یا بخشی از تصویر حذف یا اضافه شود که معمولاً با دقت زیاد قابل تشخیص است. اما در دیپ فیک، از هوش مصنوعی برای ایجاد پیکسلهای کاملاً جدید و بازآفرینی چهره یا صدای یک فرد به شیوهای بسیار واقعگرایانه و هماهنگ با حرکات ویدیوی منبع استفاده میشود. به عبارت دیگر، دیپ فیک یک “جعل عمیق” در سطح پیکسلی است، نه یک ویرایش سطحی.

۳. آیا ساخت و انتشار محتوای دیپ فیک در همه جا غیرقانونی است؟

قوانین مربوط به دیپ فیک هنوز در بسیاری از کشورها در حال توسعه و تکامل هستند. در اکثر نظامهای حقوقی، اگر از دیپ فیک برای اهدافی مانند کلاهبرداری، افترا، اخاذی، یا تولید محتوای غیراخلاقی بدون رضایت استفاده شود، این عمل تحت قوانین موجود قابل پیگرد قانونی است. با این حال، استفاده از این فناوری برای اهداف هنری، طنز یا نقد (پارودی) در یک منطقه خاکستری قانونی قرار دارد که مرزهای آن هنوز به طور کامل مشخص نشده است.

۴. آیا ابزارهای آنلاین، اپلیکیشن یا نرمافزارهای رایگانی برای تشخیص دیپ فیک وجود دارد که من به عنوان یک کاربر عادی بتوانم از آنها استفاده کنم؟

در حال حاضر، ابزارهای تشخیص دیپ فیک که به صورت عمومی و رایگان در دسترس باشند، بسیار محدود و اغلب دارای دقت پایینی هستند. بسیاری از ابزارهای قدرتمند در این زمینه، هنوز در مرحله تحقیق و توسعه در دانشگاهها و شرکتهای بزرگ فناوری قرار دارند یا به صورت تجاری به شرکتهای بزرگ و رسانهها فروخته میشوند. بنابراین، در حال حاضر، بهترین ابزار برای یک کاربر عادی، همان مهارتهای تحلیلی و تفکر انتقادی است که در این مقاله به آنها پرداخته شد.

۵. مهمترین و اولین کاری که باید پس از مشکوک شدن به جعلی بودن یک ویدیو (دیپ فیک) انجام دهم، چیست؟

مهمترین و اولین کار، عدم به اشتراکگذاری و بازنشر آن ویدیو است. هدف اصلی بسیاری از دیپ فیکهای مخرب، انتشار سریع و ویروسی شدن است.

با به اشتراک نگذاشتن آن، شما به قطع کردن زنجیره انتشار اطلاعات نادرست کمک میکنید. گام بعدی، تلاش برای راستیآزمایی (Fact-Checking) آن از طریق جستجو در رسانههای معتبر و بررسی منبع اصلی ویدیو است. اگر ویدیو حاوی تهدید یا محتوای غیرقانونی است، میتوانید آن را به پلتفرم میزبان (مانند اینستاگرام یا یوتیوب) گزارش دهید.

نتیجهگیری: سواد رسانهای، بهترین و قدرتمندترین سپر دفاعی ما در برابر جعل عمیق

در نهایت، در پاسخ به این سوال که “چگونه میتوان دیپ فیک را تشخیص داد؟”، باید گفت که در حال حاضر، بهترین و موثرترین ابزار ما، ترکیبی از آگاهی فنی و تفکر انتقادی است.

با شناخت نشانههای بصری و شنیداری که ممکن است در این ویدیوها وجود داشته باشد و مهمتر از آن، با پرسیدن سوالات کلیدی در مورد منبع، محتوا و منطق هر ویدیویی که مشاهده میکنیم، میتوانیم به طور قابل توجهی از خود در برابر افتادن در دام اطلاعات نادرست و اخبار جعلی محافظت کنیم. در آیندهای که مرز بین واقعیت و جعل روز به روز کمرنگتر میشود، سواد رسانهای دیگر یک مهارت جانبی نیست، بلکه یک ابزار حیاتی برای بقای دموکراسی، حفظ اعتماد اجتماعی و محافظت از سلامت روان خودمان است.